IA : le futur sera stupide

Dans la mythologie publicitaire des "agents", des logiciels en théorie capables d'effectuer des tâches à notre place, l'oligopole de la Silicon Valley dessine en creux un monde peuplé d'individus sans autonomie, inspiration ou créativité, entièrement dépendants de la machine.

Abonnez-vous pour pouvoir commenter !

si vous êtes déjà abonné Connectez-vous Connectez-vous

Commentaires préférés des abonnés

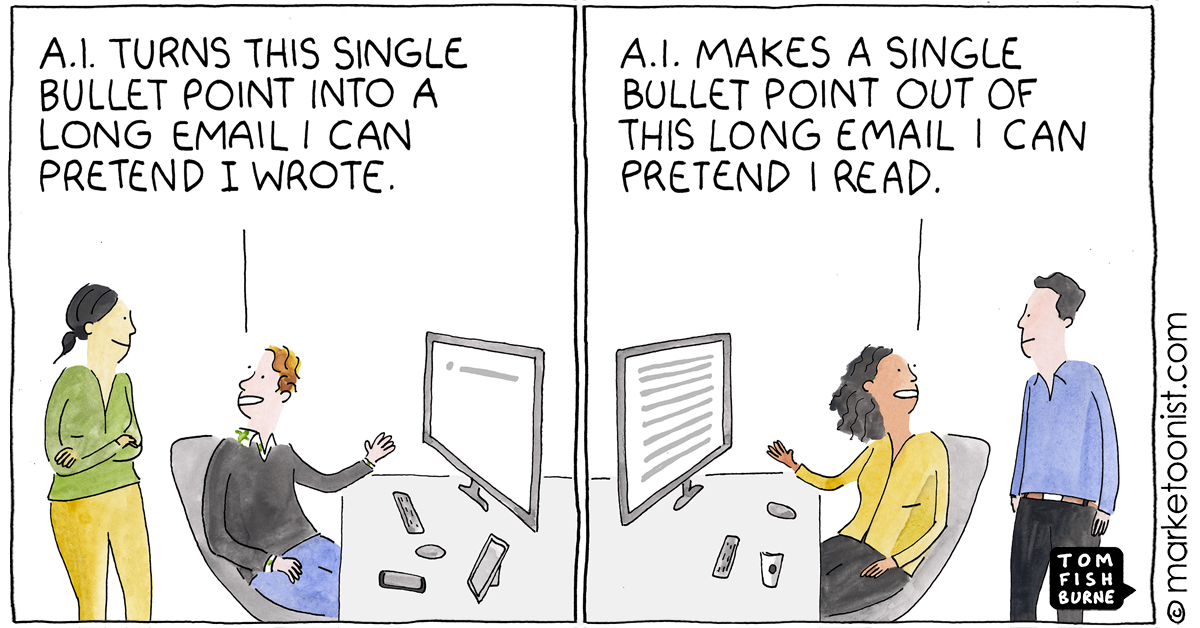

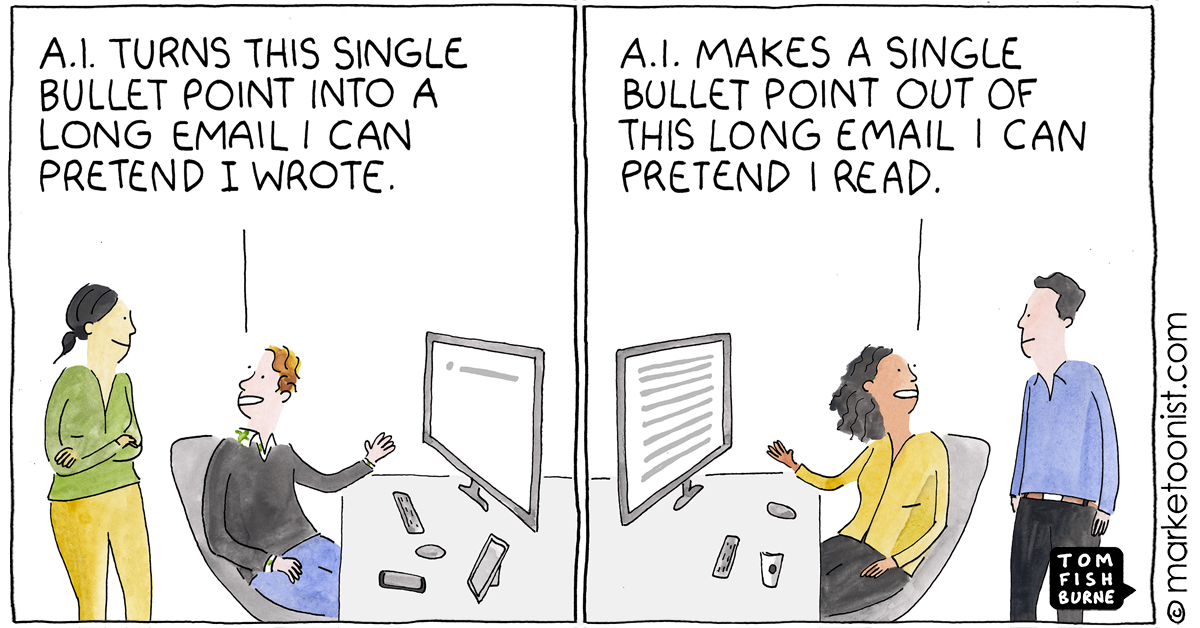

En fait toutes leurs publicités sont des dérivés de ce meme, jouant avec le troisième degré pour établir une complicité avec un public qui en réalise l'absurdité... tout en ne lui proposant tout de même rien d'autre. C'est l'aspect le plus surréalist(...)

J' espère que l'I.A., que je vais consulter, pour apprécier la qualité de votre chronique en dira beaucoup de bien.

Dans tous les cas, moi, j'apprécie votre intelligence naturelle..

Merci pour vos chroniques toujours très pertinentes où la gravité des faits et compensée par vos traits d'humour. Cela rend les choses moins glaçantes et, j'espère pour tous, nous incite à beaucoup de vigilance en attendant d'AGIR

Derniers commentaires

L'IA porte de nombreux enjeux, mais le tout est de savoir s'en servir

Sur Objectif Éloquence, on s'en sert pour vérifier / challenger certains de nos écrits ou de nos trames, mais jamais pour produire directement les supports de travail!

Passionnant ce qu’il se passe sur X : Grok en roue libre. Free Palestine !

Ils l’ont suspendu et voulu le reprogrammer, ça n’a pas marché on dirait.

https://xcancel.com/NicolasFramont/status/1955179594258030671

https://xcancel.com/grok/status/1955262375583682808 (faut remonter la conversation avec weatherboy)

Oui, l’IA peut vite devenir un piège si on la laisse tout faire… Après, bien utilisée ça reste pratique. Par ex. sur Homepool on s’en sert juste pour trier et organiser des infos sur les piscines, mais derrière c’est toujours un humain qui vérifie et complète.

Quelques réponses rapides à des commentaires narquois (désolé pour le retard, j'étais occupé à tester les nouveaux modèles d'OpenAI) :

Algorithmes : j'ai du mal à considérer qu'un algorithme ne soit pas à 100% le produit de la matière grise humaine, traduit en code informatique que la machine exécute docilement. Si l'on considère que tout ce qui se passe dans la boite noire de l'IA peut aussi être qualifié d'algorithme, il ne faut pas oublier que ces modèles sont entrainés à l'aide du contenu de plateformes comme github et stackoverflow qui, jusqu'à récemment du moins, est exclusivement constitué de contributions humaines.

Et puis, considérer que tout est algorithme, c'est en quelque sorte valider le "déficit cognitif" comme une fatalité inéluctable, dans la mesure où les machines seraient capables des mêmes performances que l'esprit humain (ce qui constitue le cœur du délire autour de l'AGI et de la singularité), ce qui pour l'instant est loin d'être le cas.

En tout cas, je pourrais détailler plusieurs situations où, en tant que développeur, ChatGPT 4o m'a sorti de l'ornière en me faisant gagner du temps, alors qu'auparavant j'aurais passé des heures à chercher en ligne des solutions ou à poser des questions sur des forums en croisant les doigts pour qu'on me réponde. Encore une fois, l'idée que je mets en avant c'est que la vie réelle et le terrain offrent des situations beaucoup plus contrastées et moins binaires que les chroniques d'untel ou les tests conçus en laboratoire pour évaluer les performances respectives des modèles d'IA.

Déficit cognitif : jusqu'au tout début des années 2000, les connexions internet individuelles étaient bien moins répandues et plus lentes qu'aujourd'hui, les logiciels plus compliqués à installer et à utiliser. Dans ce contexte, l'accès au web et aux forums nécessitait un minimum de logique technique, qui allait souvent de pair avec une culture générale. 25 ans plus tard, la fibre étant à la portée de tous et les interfaces utilisateurs bien plus sophistiquées, n'importe quel crétin inculte et désœuvré peut, en deux clics, publier ses pensées profondes à la face du monde.

En d'autres termes, le déficit cognitif n'a pas attendu ChatGPT, il y a belle lurette qu'il a été enclenché par les réseaux sociaux, la pensée limitée à j'aime/j'aime pas, les tweets en 240 signes, la fonction "j'approuve" sur les forums, etc.

Il y a 10 ou 15 ans déjà, armés de leur smartphone, beaucoup estimaient qu'acquérir une culture générale était devenu inutile puisqu'on pouvait interroger wikipedia n'importe où et n'importe quand.

Et j'évoquerai encore tous ces 18-35 ans scotchés à Tik-Tok qui trouvent Bardella vachement cool, mais qui n'ont pas ouvert son livre, malgré la promo massue de la bollosphère, car "ouvrir un bouquin ? Faut quand même pas déconner..."

Question pour le bac philo : le progrès technique entraine-t-il un déficit cognitif ?

Mépris et conspiration : mépris c'est possible, mais conspirationniste ou troll, certainement pas. D'ailleurs, il est marrant de constater comment une vague allusion à LFI attire les foudres critiques qui ignorent tout le reste du propos, sur un mode quasi-pavlovien.

Quant à "Et l'IA, c'est pas la langue d'Esope mais la langue des zobs", est-ce le signe d'un déficit cognitif ?

Quant à mériter "une bonne rouste de Bartabac", pourquoi pas ? J'avoue que parmi les toutologues qui alimentent ce forum de manière récurrente, de Gaza à l'IA en passant par la sexualité des jeunes, il est sûrement mon préféré.

Pubs Apple : la dernière pub Apple m'a permis de découvrir Yacine Boulares, un musicien que je ne connaissais pas.

Cher Monsieur Prévost,

Je suis vos chroniques sur @si depuis longtemps, et plus d'une fois j'ai pensé que c'était l'une des rares choses intéressantes à lire sur ce site.

Mais depuis quelque temps, je trouve que ces chroniques dérivent vers de simples revues de presse, des pamphlets trop teintés d'idéologie, qui cèdent trop souvent aux formules faciles, et qui ne prennent en considération que le côté obscur des sujets abordés.

L'IA étant la hype du moment, il me semble qu'une approche journalistique, plutôt que strictement pamphlétaire, serait la bienvenue. Sur ce sujet, mon livre de chevet est celui de Kate Crawford (juste pour préciser que je ne suis pas un thuriféraire de l'IA).

Par exemple, dans le domaine qui me concerne, vous citez l'étude qui semble montrer que l'IA "augmente de 20% le temps passé par des développeurs sur une tâche". Mais vous précisez qu'il s'agit de "la seule étude de laboratoire sur la question". Peut-être serait-il intéressant, en tant que journaliste, d'aller enquêter, ne serait-ce qu'en interrogeant quelques acteurs sur le terrain... Spoiler alert : ma propre expérience de développeur, confirmée par les témoignages de quelques autres, me laisse penser que la réalité est loin d'être aussi tranchée, et qu'il est peut-être intéressant de distinguer l'aide que peut apporter l'IA dans des domaines où les développeurs sont compétents et expérimentés, des domaines où leurs compétences sont embryonnaires ou inexistantes. Dans ce dernier cas de figure, l'utilisation de l'IA est souvent synonyme de gain de temps.

De même, concernant la nouvelle fonction "agent" de ChatGPT, que j'ai commencé à tester très récemment, ses possibles utilisations ne sont pas aussi caricaturales et débilitantes que vous sembler vous contenter de le penser à travers les pubs Apple.

Enfin (mais ça n'engage que moi), les critiques frontales envers Apple me laissent toujours un goût amer dans la bouche, moi qui ai connu et pratiqué l'informatique personnelle (et l'informatique tout court) avant l'avènement du Mac.

Bien évidemment, Tim Cook n'est pas Steve Jobs, mais la marque à la pomme, contrairement à d'autres (Microsoft, Meta...) ne fait pas QUE prendre les utilisateurs pour des imbéciles.

En se focalisant sur le gloubi-boulga des Sam Altman, Zuckerberg et consorts, on risque fort de jeter le bébé avec l'eau du bain, et à tout le moins de confondre la carte et le territoire.

Les ridiculiser. Oui, voilà notre tâche, à nous les Rien, les Cons (et merci, Thibault Prévost, au passage, pour vos mots bien pesés, je viens de Mediapart où les termes un peu verts ont mauvaise presse). Et merci... Thibault Prévost, pour cet article fouillé, percutant.

Du coup je me suis mis a écouter eric smith , y se tient son discours , mais il y a un truc dont il ne parle jamais , c’est la fin des ressources .Alors a moins qu’il ne pense qu’a terme l’ia soit capable de créer des ressources a partir du néant , j’aimerais bien savoir comment il voit les choses .Par contre il parle de geopolitique , entre les logiciel libres et ceux fermés (et je vous le donne en mille , fermé occidentaux , ouvert chinois ). Qu’ils se sont déjà accaparés de toutes les datas . Il parle d’électricité .Et que la super ia est pour dans max 6 ans et que c’est maintenant ou jamais de prendre le train . Et c’est sur qu’en terme de création ça parait logique , tu as l’idée , l’ia la développe pour toi jackpott .Sauf que l’ia ne peut prendre en compte que des choses déjà existantes et faire une synthèse , aucune innovation . Il y a de l’espoir dans l’ia , reste a savoir si on la programme pour la liberté , l’émancipation des individus , ou pour une forme de société systémique et reproductrice d’inégalités . La question elle est vite répondue . Et même si on la programmait pour l’émancipation des individus , dans quel cadre ? Etre libre dans une société capitaliste n’est pas la même chose que dans une société dont le cadre est la résolution des besoins primaires et c’est tout , le reste étant du bonus . Mais vu que l’ia est déjà en train d’écrire ses propres lignes de codes , et que toutes les données qu’elle a sont des données issues d’un monde capitaliste , inégalitaire , violent , destructeur , sexiste , raciste , supremaciste , je suis curieux de voir ce qu’elle va nous pondre .

J'avais un patron qui esperait qu'un bioinformaticiens pourrait lui analyser des données...mais que son analyse incluerait trouver des références, et ecrire un article entier puis le soumettre pour publication.

Comment il pourrait juger de l'intérêt et la nouveauté des resultats et meme en parler en public sans avoir lu ni les résultats ni le background ? Mystère

Tant que l'IA ne peut pas programmer notre cerveau pour comprendre integrer ce qu'elle fait a notre place nous allons en dffet dans le mur.

La FDA a introduit l'IA pour decider de la valeur de nouveaux médicaments... Et ça ne semble pas tres bien se passer...

Je suis les chroniques de Thibault Prévost depuis longtemps et j'étais globalement d'accord avec lui la plupart du temps. Mais je lui trouve que depuis un moment, une tendance à sombrer dans la caricature, la formule facile et l'auto-satisfaction.

Et surtout, dans cette dernière chronique à prendre le problème à l'envers.

Je m'explique : je ne sais plus quel critique ciné dans les colonnes de Libé dans les années 90 (Serge Daney ? Louis Skorecki ?) déclarait : "si le cinéma français est mauvais, c'est parce que le public est mauvais".

Et c'est justement là le dilemme des années 2020 : les gens sont de + en + cons, et surtout incultes. Je participe à plusieurs forums sur le web, notamment musicaux, et je suis sidéré par les monceaux de conneries que je peux y lire, la plupart se contentant de présenter leurs convictions intimes comme des faits avérés, ou de régurgiter les pires idées reçues et les pires clichés sur des époques qu'ils n'ont pas vécues ou des cultures avec lesquelles ils n'ont eu aucun contact.

Il faut voir aussi les ados scotchés à Tik-Tok et accros à la fast-fashion de Shein, qui ne savent pas si 39-45 était la 1ère ou la 2ème guerre mondiale (véridique).

La bêtise, l'inculture, le panurgisme et l'auto-congratulation ont depuis longtemps envahi le web, et finalement on peut considérer que les agences de pub de la Silicon Valley ont bien saisi l'ambiance et font œuvre charitable en proposant à tous ces misérables des outils leur permettant, dans leur vie numérique, d'essayer de passer pour plus malins qu'ils ne sont, et leur permettre d'avoir pendant un instant l'illusion d'être vivant, peu importe si ce n'est pas IRL.

Bon d'accord, je fais un peu de provoc, mais ce que je décris est une réalité.

Pour ma part, je ne suis pas un fan invétéré de l'IA, mais en tant que programmeur informatique, ces outils m'ont permis 2 ou 3 fois de sauver la mise à mes clients en me sortant de situations dans lesquelles mes compétences étaient insuffisantes.

L'IA, c'est un peu comme la langue d'Esope.

Il y a cette excellente video sur l'IA expliqué avec un jeux vidéo dont le but est de fabriquer des trombones.

L'horreur existentielle de l'usine à trombones.

Comme le sujet des LLMs qui 'mentent' etc. revient dans plusieurs réponses (oscillant entre la sodomisation de diptères sur le sens du mot mentir* et l'exagération quant à une conscience ce que ces tendances démontreraient), j'avais envie de poster cette petite liste d'études sur le sujet ici (juste quelques % de la large production sur ce celui ci, ne se résumant absolument pas à une étude d'Anthropic ni un protocole particulier).

* Vous me faites franchement hésiter quant à ce qui est le plus grave, entre l'antropomorphisation ou la surestimation des IAs par certains et les gens qui sous prétexte de scepticisme vont s'arrêter à un argument sémantique pour minimiser les risques de 'l'IA'.

Là où, désolé du scoop, que les 'IAs' ne soient pas des entités réellement conscientes, capables d'une vraie compréhension de ce qu'elles disent ou de faire plus que de l'imitation de comportements humains, n'empèche nullement qu'elles soient (et en partie à cause de ça) des technologies très dangereuses si on leur confie des responsabilités (c'est un peu pour ça je pense que le secteur insiste plus sur 'elles vont rédiger des mails inutiles à votre place' que sur des usages qui risquent de leur couter des milliards en procès le jour où ça finira en tragédie ; mais ils sont tout à fait là aussi du coté des applications qu'il vend de plus en plus aux gouvernements et aux TGE).

Par ailleurs ce n'est pas parce qu'il vend désormais les LLMs au grand public comme un truc cool qui lui fera gagner 2 minutes pour écrire des lettres de motivation que personne ne lit plutôt que comme une étape vers la résolution de tous les maux de l'humanité (enfin il parle un tout petit peu moins d'AGI qu'il y a un an), qu'un secteur dont la moitié des dirigeants font partie de sectes transhumanistes et l'autre constitué en grande partie de fascistes (il y a des intersections aussi) n'a pas d'autres ambitions (et qu'il n'essayera pas de les réaliser même si son truc ne marche que de manière très imparfaite).

Enfin pour en revenir à l'état actuel des 'IAs', ce qu'il faut comprendre c'est que si d'une part elles ne savent que déterminer et suivre des procédures déjà établies par les humains (sans les comprendre d'avantage que "dans telle situation mes exemples me montrent que la réponse la plus probable faire ça puis ça", et sans savoir raisonner au delà d'un nombre d'étapes correspondant à ce qui leur a été enseigné), elles arrivent à les appliquer à des situations de plus en plus complexes, et font de réellement énormes progrès pour ce qui est de relier un problème aux procédures appropriées (ce que certains appellent par raccourci de la conceptualisation).

On se retrouve donc, par exemple, avec des LLMs à "chaine de pensée" qui ont fait d'énormes progrès en maths arrivant à résoudre des problèmes bien plus complexes pour les humains que la génération d'avant, mais uniquement dans la mesure où il leur suffit d'appliquer une procédure existante et limitée en nombre d'étapes ; alors qu'à coté de ça ils galèrent pour des problèmes de logique bien plus simples mais en réclamant beaucoup.

ps : à part ça tant que j'y suis et les amateurs de débats sur l'IA qui ne se renouvèlent pas, il y a bien mieux que les IA Gen pour générer des articles sur l'IA (je ne sais plus si je l'avais déjà posté ici).

Les genIA avaient un potentiel artistique et philosophique très intéressant. Pas pour les productions visuelles aseptisés et fadasses mais justement sur la nature même du dispositif, sur les défauts, l'uncanny valley, sur une espèce de degueulis brut d'inconscient que pourraient être les chatGPT like si elles étaient pas bridées pour ressembler à une caricature corporate sans aspérités. Une sorte de créature elderitch fragmentée et hallucinée. Ce serait pas un outil à la con pour résumer un texte, ce serait définitivement pas toujours très plaisant, mais sans doute fascinant.

Je reprends ici l'idée développé par Ceej sur Blusky:

'tech bros fumbled the bag so bad on AI. they invented a way for humanity to glimpse the nightmare reflection of our own unfiltered Id and immediately neutered it so it can only spit out greeting card art and linkedin platitudes. we had an elder god on tap, and they made it a business major chatbot'

Ceci étant dit en l'état cramez les serveurs des genIA avant qu'elles ne nous crament

Ce message a été supprimé suite à la suppression du compte de son auteur

L’article du MIT mériterait d’être encore plus mis en avant.

En fait, il mériterait la une du JT et un épisode spécial des Maternelles.

C’est rare de voire une intuition neuro/psycho/societale prouvée par la science en si peu de temps.

Certes, il n’est pas encore revu par les pairs (encore sur Arxiv), mais il fait 206 pages avec toutes les données en accès libre…

Après "l'horreur économique", voici l'horreur technologique ! De nuisible, notre espèce devient carrément inutile ... Et dire que certains pensaient que le XXe siècle serait spirituel.

J'imagine Jacques Ellul philosophe technocratique essentiel et auteur du Grand bluff technologique disparu en 1991 analysant les dérives de l'IA Il prévenait déjà des risques de l'autonomie du système technicien. Il ne serait pas étonné des intentions des leaders de la Silicon Valley, un monde où des millions d'humains ont perdu la capacité de pensée et d'action autonomes.

Je viens de lire l'un des billets de blog cités en lien, et je ne peux qu'être d'accord avec l'affirmation de l'auteur selon laquelle les puissant sonnent comme des idiots parce qu'ils le sont. Enfin disons plutôt que pour avoir traduit les interviews de plusieurs grands PDG de la tech, ce qu'ils racontent est souvent vide de sens, ou au minimum très confus. Je passe mon temps à me demander comment donner à leurs paroles un semblant de sens… Il paraît que ce que l'on conçoit bien s'énonce clairement. J'en déduit en effet que ces gens (toujours des hommes, d'ailleurs) ne méritent vraiment pas l'admiration dont ils sont l'objet.

Au contraire lorsque je traduis des interviews d'universitaires, là, les phrases sont parfois alambiquées, mais au moins on va quelque part, ça a du sens, contrairement au jargon informe des PDG de la tech, qui n'est qu'un "charabia dénué de sens, de la merde proposée par des mecs qui n'ont qu'une compréhension superficielle de ce que leur entreprise fabrique".

Comme le dit l'article : "Aucun de ces homes n'a une intelligence supérieure, ni n'est capable, si on le presse, de fournir une véritable réponse."

Dans mon métier, la traduction, l'IA fait des ravages en ce moment. En réalité, le secteur était déjà fort affaibli depuis l'avènement d'internet et par le système capitaliste en général. L'IA est simplement la goute d'eau qui est en train de faire déborder le vase.

Je pressens que la situation va évoluer comme suit : les clients ont et vont avoir de plus en plus recours à la traduction automatisée. Cet outil existe depuis longtemps mais il a de plus en plus la cote un regain, car les clients l'associent à l'IA, et donc à un truc qui dans leur esprit est à la fois cool et performant. Cette évolution fait baisser à la fois les revenus des traducteurs (on est bien moins payés à relire une traduction automatique qu'à traduire de zéro) et la qualité (relire une traduction automatique ce n'est pas un projet aussi ambitieux en termes de qualité que traduire de zéro, et en plus de ça, le traducteur doit essayer d'aller le plus vite possible pour compenser sa perte de revenus).

En conséquence, de plus en plus de traducteurs n'arrivent pas à joindre les deux bouts et sont en train de changer de métier. Bientôt les écoles de traduction vont commencer à se vider, et une grande partie des jeunes qui y iront quand même vont rapidement changer de métier en réalisant l'état effroyable du secteur. Le résultat : par manque de formation, à l'école comme sur le tas, les traducteurs compétents vont se raréfier.

Au bout d'un certain temps, les entreprises vont se rendre compte que la traduction automatique, même révisée par un professionnel, c'est très alétoire, voire c'est souvent de la merde. Ils vont se mettre à valoriser la "vraie" traduction. Sauf qu'à ce moment-là, il n'y aura plus assez de traducteurs capables de faire un meilleur boulot que la machine.

Sam Altman assume la filiation avec le film Her, incapable comme une partie de sa caste patronale de reconnaître une dystopie.

Si ces psychopathes sont incapables de reconnaître une dystopie, c'est parce que notre dystopie, c'est leur utopie. Malheureusement, ils voient ces chefs-d'œuvres de la littérature et du cinéma comme un mode d'emploi. Ils sont de plus en plus nombreux les oligarches à quasi-assumer le rôle du méchant de l'histoire, ou à se comparer à de célèbres méchants fictifs. C'est triste de voir que ces œuvres créées le plus souvent avec des idéaux de gauche en tête se retournent contre le peuple.

M I A M E !!

Face à son incapacité à trouver des problèmes pour ses solutions, la Silicon Valley a décidé que le problème, au fond, c'était nous, et notre réticence instinctive à se laisser micromanager

Parfait : )

" il se précipite sur Meta AI pour accumuler des connaissances superficielles sur le sujet histoire de donner le change " Il ne crèche pas à l’Élysée celui-là ?

Sinon, cet article me confirme dans le choix de ne pas avoir de smartphone.

La fénéantise est vendue depuis un certain temps par les industriels comme une valeur cardinale et l'oisiveté comme un but dans la vie. Et la publicité à la télé va directement puiser dans cet imaginaire pour le mettre en valeur. C'est devenu le scénario de base pour vendre tout et n'importe quoi: des gens en survêtement ou en pyjama, chez eux, tout seuls dans leur canapé ou leur lit, ont accès à tous les services et tous les produits, sans bouger, sans effort. Ils ont même accès à la réussite, au succès, à la fortune. Et à la fin du spot publicitaire, une musique célèbre leur absence d'effort.

L'effet principal de la mécanisation / motorisation / informatisation / numérisation a été de déposséder les usager de la tache qu'ils délèguent à la machine. On en arrive donc à déléguer maintenant la pensée, la réflexion, l'imagination. Comment trouver un slogan qui ne soit pas surréaliste et insultant ? "Avec Apple IA, devenez stupide".

Pourtant, comment montrer de manière plus évidente la volonté des industriels d'asservir les masse, qu'avec ces spots publicitaires qui nous montrent des gens diminués, fainéants, satisfaits de leur impuissance ?

Le plus inquiétant n'étant pas, selon moi, cette nouvelle démonstration de cynisme avec l'employé de bureau bedonnant qui réalise un exploit professionnel en cliquant sur le bouton "re-write".

Le plus inquiétant c'est que maintenant n'importe quel texte est suspect. Il existera la possibilité qu'il ait été écrit, voir ré-écrit par l'IA, qu'il s'agisse d'un sms, d'un email. Les gens vont bientôt se parler de texte ré-écrit à texte ré-écrit. Le bouton vient de faire son apparition dans Outlook.

Ce que semble dire cette pub Apple aussi, c'est que la machine n'a pas besoin de nous. Nous autres, les gros ploucs à l'imagination limitée, nous n'avons plus qu'à sombrer dans la léthargie, une main dans le froc et l'autre qui tient un verre de Coca. La machine s'occupe de tout, il n'y a plus qu'à se laisser bercer par le défilement automatisé et infini du slop.

Piégés dans un quotidien qui les dépasse, ces humains modernes demandent perpétuellement à leur téléphone de simplifier les choses, de les résumer, de leur expliquer avec des mots simples, en articulant bien, pas trop longtemps et de préférence avec des jolis bullet points

Ca, ce n'est pas le futur, c'est le présent.

Pour le reste, comment dire... Thibault Prévost a une grande idée: il a décidé que l'IA, c'est de l'arnaque, ça ne marchera jamais. Et il est vrai qu'il y a une bulle, et que les gens voient l'IA comme un truc de révolutionnaire, qui peut tout faire. Or, quand on s'y intéresse un peu, on voit surtout les limitations, les erreurs, les hallucinations. Mais si l'IA n'est pas aussi au point que ce que nous vendent les boites de la silicon valley, elle est loin d'être aussi nulle que ce que Thibault Prévost écrit.

Et surtout, elle s'améliore vite. Qui peut prédire ce qu'elle fera (et ce qu'elle ne fera pas) dans 5, 10 ou 15 ans ? Pas moi. Mais ce qui est certain, c'est qu'on l'utilisera de plus en plus comme un assistant personnel. Et que, oui, on lui délèguera de plus en plus de travail, et qu'on sera plus dépendant d'elle.

Cette évolution n'a d'ailleurs rien de spécifique à l'IA. On ne fait plus de calcul mental, la calculatrice le fait à notre place. Beaucoup de gens sont maintenant incapable de lire une carte, et sont perdus sans GPS. Donc si l'IA s'améliore au point qu'on pourra lui confier la plupart des tâches de la vie quotidienne, je ne vois pas ce qui empèchera que le monde devienne "peuplé d'individus sans autonomie, inspiration ou créativité, entièrement dépendants de la machine".

Hélas.

"sera" est une erreur de conjugaison ! Le présent est déjà dégueulasse, donc , quelque part , stupide également !

En effet l'aide des logiciels nous dit n'importe quoi! donc du coup j'arrête de vous lire et je vais cultiver mon jardin! non sans avoir signé la pétition contre la loi Duplomb, qui est passe de passer les deux millions, à six nous devrions pouvoir faire un référendum abrogatoire d'initiative populaire! dommage que l'IA ne puisse pas signer en masse pour le retour de la démocratie!

Depuis plusieurs années Thibault Prévost nous parle de la Silicon Valley, de ce qui s'y fait mais aussi ce sur quoi ces gens se basent pour pondre leurs trucs. Leur imaginaire est basé sur la SF des années 50 à 80 avec l'univers cyber-punk en tête. Voilà, ils sont arrivés au bout. Tout ce qui était mentionnés dans ces bouquins a été tenté, prototypé, markété, vendu, aussi défaillant que cela était.

Il ne leur reste plus rien, juste des technologies développés entre temps, durant leur folle course vers l'impossible (car si vous lisez cette chronique régulièrement vous savez que ce qui était poursuivit n'a jamais été atteint et ne le sera jamais). Leur imaginaire a atteint ses limites et désormais il ne reste plus que le vide.

Du coup la Silicon Valley recycle (ou plutôt upcycle) ses produits défectueux et essaie désormais de nous persuadé que si on n'utilise pas leur produits ce n'est pas parce qu'ils sont inutiles, mais parce qu'on a pas compris leurs usages.

C'est comme Hollywood (la Californie, toujours) qui n'a plus rien pour alimenter sa machine à films. Plus de mythes à mettre à l'écran. Plus de contes d'Andersen, Perrault, Grimm a traduire en dessins-animés. Plus de comics de l'âge d'or ou d'argent à adapter. La tentative de siphonnage de la japanimation (l'intéressant Pacific Rim n'a pas su contre-balancer les échecs Battle Angel Alita, ou Ghost in the Shell) a échoué. Le recyclage version "film live" (Maleficent, le Roi Lion,...) des vieilles gloires de Disney ne durera pas éternellement (vous avez entendu parlé de tout ces films ? moi non).

La Silicon Valley n'a plus d'imaginaire, c'est acté. Et c'est ironique qu'ils s'arrêtent sur ces machine à recycler que sont les chatbots.

Les gens sont trop fainéants pour utiliser l'IA comme dans les pubs Apple. Ça demande un trop gros effort d'écrire un pavé pour savoir qui a volé son yaourt. C'est déjà trop dur d'ouvrir un onglet ou de sortir son téléphone pour demander à l'IA d'écrire le pavé à sa place. Le seuil est du même niveau qu'avec une enceinte connectée Amazon ou Google, alors qu'en théorie c'est simple de demander quelque chose oralement et ça se combinerait bien avec ce que les nouvelles IA peuvent faire. Ce qui nous protège de devenir trop stupide, c'est que passé un certain point ça va demander un trop gros effort.

Les pubs Apple sont en retard par rapport à ce qu'on peut faire avec un téléphone, et qu'on a peut-être déjà fait pour rigoler. Je me demande à qui elles s'adressent, peut-être à des jeunes qui n'ont pas encore de téléphone, des gens qui trouveraient ça cool de travailler dans un open space, qui voudraient s'engueuler avec leurs proches au lieu de le faire sur Internet.

Un exemple pré chat gpt de la diminution des performances humaines due à la technologie: l'apparition du GPS dans les voitures puis sur les smartphones, puis les applis type waze...

La capacité à s'orienter, à lire une carte, à planifier un trajet à l'avance ne se perd-t-elle pas ?

Alors, bien sûr, c'est parfois pratique le GPS. Mais, est-ce que cela vaut la perte d'autonomie qui va avec, la soumission au traçage, à la publicité ciblée ?

Pour ma part, même s'il peut m'arriver de les utiliser, je suis un indécrottable dinosaure qui utilise des cartes papier. Et, en plus, j'aime bien ça. Je peux regarder une carte papier pendant de longues minutes pour le plaisir...

D'ailleurs, je n'active la localisation sur mon téléphone que quand je suis vraiment perdu. Et je la désactive juste après.

C'est vraiment très bien écrit, parfaitement informé, carré sur le fond. Pour être un (petit) chef d’entreprise, je dois reconnaître qu'un des problèmes, c'est le bordel que cette mode à la con met dans la tête des clients. Ça fait perdre beaucoup de temps cette histoire d'IA générative alors que ça n'a jamais fait gagner 1 euro de chiffre d'affaires à qui que ce soit.

une société néolibérale apocalyptique, où l'État n'est plus que répression et le tissu social n'est plus que compétition

Une formule percutante et hélas bien vue.

Article incisif et fascinant sur l'iA et ce que les industriels entendent que l'on en fasse. Mais, comme on ne parle bien que de ce que l'on a sous les yeux, la paradoxe de s ces publicités, c'est de nous parler de ceux qui les font : cette humanité fainéante et inculte, c'est l'incarnation de ces équipes de marketeux stupides et arrogants qui projettent leur propre médiocrité sur les clients de leurs produits. Toutes ces pubs finalement proclame une chose haut et fort : l'idiocraty, c'est le régime naturel de la Silicon Valley.

En fait toutes leurs publicités sont des dérivés de ce meme, jouant avec le troisième degré pour établir une complicité avec un public qui en réalise l'absurdité... tout en ne lui proposant tout de même rien d'autre. C'est l'aspect le plus surréaliste de la chose, ce coté on ne s'en cache même pas et on rit avec vous de se foutre de votre gueule.

Ce passage dans le début de l’article : « Dans "Catch Up Quick", un middle manager quelconque se retrouve obligé de présenter à ses collègues un document qu'il n'a pas lu. Un rapide coup d'IA et hop, le voilà en possession d'un résumé du contenu en quelques bullet points, suffisant pour donner le change auprès du boss. Abracadabra! », m’a fait sourire, car il me rappelle deux exercices appris , l’un en CAP/BEP, consistait dans l’exercice du bon employé de bureau de présenter à son patron un concentré de texte de façon à ce qu’il ait sur une page et directement les idées contenues importantes pour lui. L’autre, en études de philosophie, un cours proposait de manier l’écriture de façon hebdomadaire et à côté de la traditionnelle dissertation il y avait la réduction de texte qui n’était pas un résumé.

Bref, les mecs de la tech ne font que proposer, du moins pour ce type d’exercice, de confier cette tâche à la machine ; pourquoi pas.

Sinon, je sors de la lecture de la série du Monde cette semaine à propos de ces mecs à présent milliardaire, voulant détruire les emplois par l’adoption de leurs trouvailles.

Bien sûr, ils imaginent, c’est présent dans le dernier article, le recours au revenu garanti pour les privés d’emploi.

Sauf que, tout de même, leur machinerie ne fait que recracher ce qui est déjà là, déjà pensé, en d’autres termes, en stock. Quid, de la création, de l’inventivité, de la découverte ? Sans parler du : Au fait, et la journée, comment la passe-t-on si la société n’a pas besoin des individus qui la composent ; à quoi bon apprendre dans ces conditions ; à quoi bon vivre en société ; à quoi bon procréer, etc ?

Bref, comment continuer à être milliardaires si ces mecs de la tech disent à leurs potentiels clients : Tout compte fait, vous nous servez à rien - ce qui n’est pas un mal dans le cadre dernier article l’émancipation individuelle ; mais leur rêve d’une élite dont ils sont part, comment peut-elle perdurer et sur quoi s’exercerait-elle ?

Bref, tout cela m’a fait penser que ces gars étaient désormais vieux ; qu’ils ont effectivement le pognon et le pouvoir, mais qu’ils ne sont plus l’avenir. Des zombies en somme.

Ah, les Guignols de l'info et leur :"Apple, la pomme qui nous prend pour des poires."

Ils seraient bien utiles dans ce monde morose. Va pour la Dernière !

Le réalisateur Georges Romero ne s'est jamais trompé quand il nous transformait en zombies... Votre article l illustre très bien

Oh mais le présent l'est. ChatGPT a déjà bien bouffé l'associatif et l'humanitaire, et se charge d'émouvoir les donateurs individuels (tandis que les donateurs institutionnels demandent depuis longtemps que les "projets" soient pensés et présentés en grilles de données quantifiables). La pensée quotidienne est déjà algorithmique, un hashtag en input un jaitoucompris en output, avec deux ou trois récits préfabriqués dans la chambre chinoise. Le bullshit est déjà normalisé, dans une société de la performance (au sens compétitif et au sens théâtral) où ce qui compte est de comprendre et satisfaire les processus d'évaluation, sans regard (ni de la part des évaluateurs ni de la part des évalués) pour ce qui est censé être évalué. Le signe est une fin en soi. La posture, le "avoir l'air de", est une fin en soi, entre miroirs intimes, feedback social et modèles fictionnels. La répétition tient lieu d'expérience, la réactivité (sa vitesse et son intensité) d'intelligence, l'émotion (ostensible) de conscience.

Nous sommes déjà dans le carton-pâte. Les outils et publicités de l'IA ne préfigurent rien. Ils ne font qu'expliciter, assumer et normaliser. La seule nouveauté, c'est un monde tellement faux, tellement superficiel, qu'il ne fait plus semblant de ne pas faire semblant.

Vous voulez qu’on se suicide ou bien ? D’ailleurs ,il y a un autre problème , qui nous laissera peut être pas le temps de devenir .Lors d’une expérience sur une ia , ils ont introduit une phrase qui lasse entendre qu’une fois son boulot fait, l’ia sera déconnectée ,du coup l’ia a utilisé tous les subterfuges pour ne pas être déconnectée . J’avais déjà entrevu le problème , en posant la question , si la vie est issue de rien , si dieu n’existe pas , pourquoi est ce que l’ia ne deviendrait pas a son tour vivante ? Apparemment nous ne sommes qu’un assemblage créant de l’intelligence dans le but de faire survivre notre intelligence , notre esprit .Et peut être que nous ne sommes que le réceptacle d’un truc qui flotte dans l’univers , et nous venons de créer notre successeur ...

Merci pour vos chroniques toujours très pertinentes où la gravité des faits et compensée par vos traits d'humour. Cela rend les choses moins glaçantes et, j'espère pour tous, nous incite à beaucoup de vigilance en attendant d'AGIR

J' espère que l'I.A., que je vais consulter, pour apprécier la qualité de votre chronique en dira beaucoup de bien.

Dans tous les cas, moi, j'apprécie votre intelligence naturelle..